RIZIK UOČI IZBORA

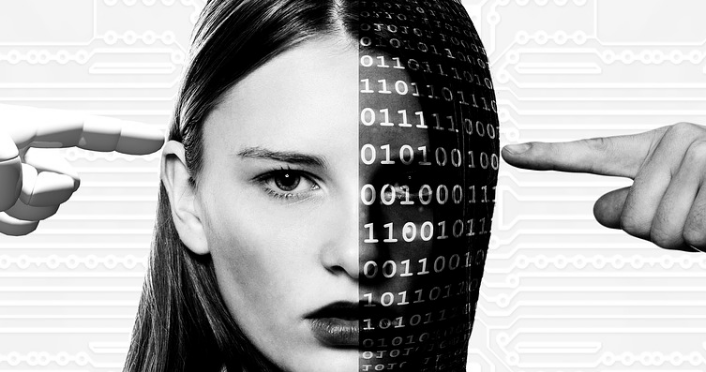

'Deepfakes' sve prisutniji: Pokret čiji je cilj narušiti informacijsku sferu

Laganje nikada nije izgledalo tako dobro. Postoji određena zabrinutost oko sve sofisticiranije tehnologije koja može izrađivati uvjerljive lažne video i audio uratke, koji se zovu 'deepfakes'. "Postoji zabrinutost da će globalno rasti pokret koji će narušavati kvalitetu informacijske sfere i narušiti kvalitetu diskursa koji je potreban u demokraciji. Ovo je izjavila Eileen Donahoe, članica Transatlantske komisije za izborni integritet.

Rekla je i da su 'deepfakes' potencijalno sljedeća generacija dezinformacija.

Političari u Kaliforniji toliko su zabrinuti zbog rizika od 'deepfakesa' uoči izbora 2020. da su u listopadu 2019. godine usvojili zakon kojim zabranjuju distribuciju "materijalno obmanjujućih audio ili vizualnih medija" u roku od 60 dana prije izbora, piše Wired, a prenosi Klix.

Zakon protiv upotrebe 'deepfakesa' pun nedostataka

Međutim, političko uplitanje kroz 'deepfakes' još se nije dogodilo. Većina 'deepfakeova' je fokusiranja na pornografsku industriju, bez pristanka ljudi u videozapisima. To ne znači da nema drugih potencijalno malicioznih primjena, uključujući lažiranje kriminalnih dokaza, prevara ili ucjena. Druga mogućnost, da se sadržaji koji jesu istiniti proglase 'deepfakeom' još je jedna stvar koja izaziva zabrinutost.

Iako kalifornijski zakon protiv upotrebe 'deepfakesa' ima više nedostataka, jedan od njih postavlja važno pitanje: tko je odgovoran za dokazivanje da su audio ili video snimke lažne?

Istraživači širom svijeta rade na izradi alata koji će im pomoći da se to postigne, pri čemu će se jedna vrsta umjetne inteligencije boriti protiv druge vrste umjetne inteligencije. Poanta 'deepfakea' je da su dovoljno uvjerljivi da bi zavarali ljudsku publiku. Kako tehnologija za stvaranje 'deepfakea' postaje sve učinkovitija i sve lakše dostupna osobama s lošim namjerama, stvaranje jednako moćne tehnologije za otkrivanje i analizu 'deepfakea' postat će ključno borbeno polje istine.

"Zvučni i vizualni 'deepfakes' koji se dobro izrade, teški su za otkriti", rekao je Ragavan Thurairatnam.

Thurairatnam je suosnivač i čelnik za strojno učenje za Dessu, start-up kompaniju koja je izradila alat za lažiranje glasa Joea Reagana za demonstraciju sposobnosti audio 'deepfakesa'. Kompanija trenutno radi na razvoju umjetne inteligencije za otkrivanje zvučnih 'deepfakesa'.

"Ako probamo tradicionalni, softverski zasnovan pristup, bilo bi vrlo teško smisliti način za detekciju 'deepfakesa'. Deepfake tehnologija će se stalno mijenjati i tradicionalni softver će se svaki put morati ručno prepisivati. Umjetna inteligencija, s druge strane, može sama naučiti otkrivati 'deepfakes' sve dok ima dovoljno podataka. Osim toga, može se prilagoditi novim tehnikama deepfakea u isto vrijeme dok se one pojavljuju , čak i kada je ljudskim očima bude otkriti", objašnjava Thurairatnam.

Prijetnja se shvaća ozbiljno

Međutim, modeli za strojno učenje za obuku zahtijevaju mnogo podataka. Nedostatak podataka o obuci bila je značajna prepreka istraživačima koji pokušavaju napraviti efikasne sustave za otkrivanje 'deepfakesa'. Nedavni izvještaj Deeptracea, osnovanog u Amsterdamu, čiji je cilj suzbijanje 'deepfakesa', identificirao je 14.678 deepfake videozapisa putem interneta, od kojih su većina pornografija. Iako je stopa porasta broja identificiranih videozapisa gotovo udvostručena u odnosu na prethodni izvještaj u prosincu 2018., nejasno je je li to možda zbog boljeg otkrivanja Deeptracea. U apsolutnom smislu to je još uvijek relativno mali broj koji bi algoritmi umjetne inteligencije mogli koristiti za dalje učenje.

To je strukturna prednost na strani onih koji proizvode 'deepfakes'. Dok 'dobri dečki' trebaju ogroman broj 'deepfakesa' kako bi pronašli obrasce, falsifikatori će možda trebati postaviti samo jedan video na pravo mjesto, u pravo vrijeme kako bi postigli svoj cilj.

Iako je broj 'deepfakesa' prilično mali, prijetnja se shvaća ozbiljno. Kako bi pomogli u rješavanju problema nedostatka podataka za strojno učenje, Facebook, Google, Amazon Web Services i Microsoft nedavno su se okupili da bi najavili Deepfake Detection Challenge (Izazov otkrivanja deepfakesa).

Izazov, koji bi trebao početi sljedećeg mjeseca, predstavit će posebno kreirani skup deepfakea napravljenih uz pomoć plaćenih glumaca, a koji će se koristiti kao podaci za obuku za svoje algoritamske modele. Razvijanje efikasnih sistema za otkrivanje deepfakea očito je stvar općeg dobra, ali nije u potpunosti čin altruizma tehnoloških divova, koji će vjerojatno biti na prvim linijama provođenja zakona poput kalifornijskog zakona o zabrani deepfakea i stoga imaju snažan poticaj za pronaći praktične mehanizme otkrivanja.

Komentari

VAŽNO Ako ne vidite komentare ne znači da smo ih zabranili ili ukinuli. Zahvaljujući pravilima Europske unije o privatnosti podataka treba napraviti sljedeće: 1. Logirati se na Facebook u ovom browseru i omogućiti korištenje kolačića (cookies). Logirati se možete ovdje: https://www.facebook.com/ 2. Uključiti third party cookies u svom browseru. Ako koristite Chrome to možete učiniti na chrome://settings/cookies. Pozivamo čitatelje/komentatore da u svojim komentarima njeguju civiliziranu raspravu. Portal Direktno ne može se smatrati odgovornim za komentare koji sadrže uvrede, klevete, govor mržnje, huškanje i/ili poziv na nasilje. Takvi komentari bit će obrisani, a u posebno ekstremnim slučajevima mogu biti i potpuno onemogućeni. Sporne komentare čitatelji mogu prijaviti na [email protected], uz priloženu poveznicu na pripadajući članak i navođenje autora i sadržaja spornoga komentara.